ニュース

Armが自社設計CPU「Arm AGI CPU」を発表、エージェント型AIに特化

2026年3月25日 12:41

英Armは25日イベント「Arm Everywhere」を開催し、エージェント型AI時代のクラウドインフラを支える自社設計の量産型プロセッサ「Arm AGI CPU」を発表した。同社が35年以上の歴史で自社設計の量産半導体製品を提供するのは、今回が初めての試みとなる。

新CPUは次世代のAIインフラ向けに設計され、従来のx86プラットフォームと比較してラックあたり2倍以上のパフォーマンスを実現する。

自社設計シリコンへの拡大と背景

Armはこれまで、IPライセンスやコンピュート・サブシステム(CSS)の提供を主軸としてきた。今回の発表により、自社設計シリコンの導入という新たな選択肢がエコシステムに加わる。

背景には、ソフトウェアエージェントが自律的にタスクをこなすエージェント型AIの急速な普及がある。AIシステムが常時稼働する中で、CPUはアクセラレータの制御やデータ転送を統括する中核的な役割を担う。

エージェント駆動型アプリケーションをスケールさせるには、電力枠内でより多くの演算能力が必要とされる。Arm AGI CPUは、こうしたAIスケールのインフラ需要に応えるために開発された。

Arm AGI CPUの技術仕様と性能

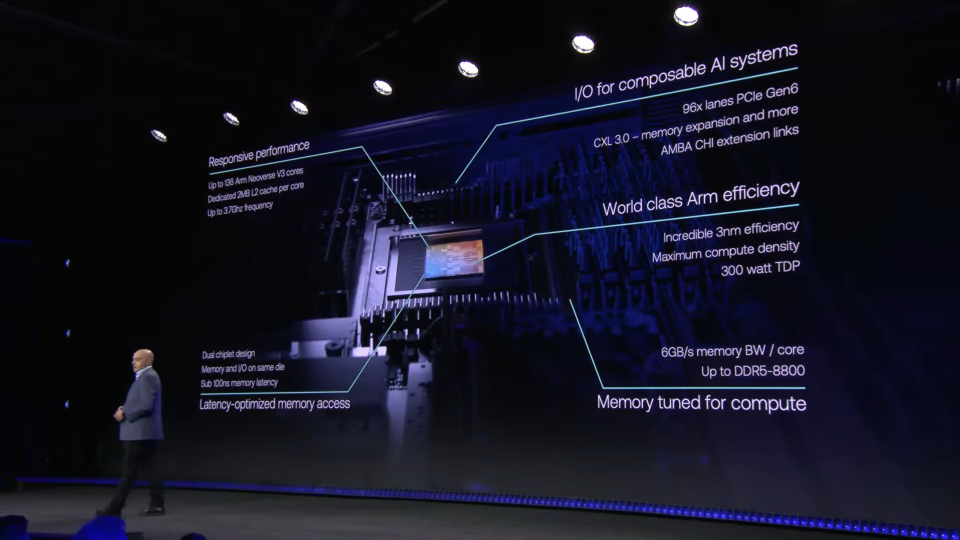

Arm AGI CPUは、1チップあたり最大136個のArm Neoverse V3コアを搭載する。各コアには専用の2MB L2キャッシュが備えられ、最大3.7GHzの動作周波数を実現する。

メモリ性能も強化され、コアあたり6GB/sの帯域幅を100ns未満の低レイテンシで提供する。最新の3nmプロセス技術の採用により、高い演算密度と電力効率が両立される。

接続性においては、96レーンのPCIe Gen6やCXL 3.0をサポートする。300WのTDP(熱設計電力)という枠内で、持続的な高性能を発揮する設計となっている。

ラックレベルでの効率とコスト削減

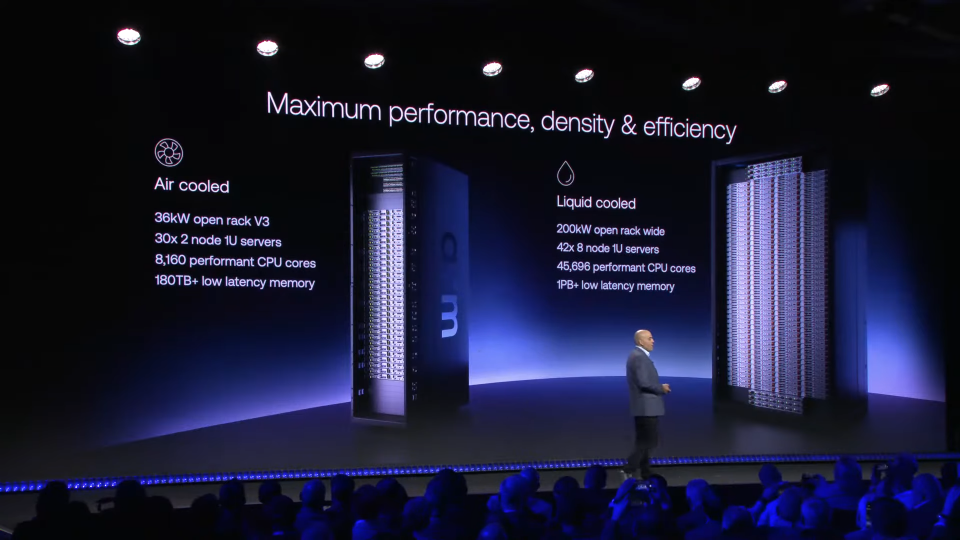

ラックスケールでの効率を重視し、高密度なサーバー構成に対応する。標準的な空冷36kWラックでは、30ブレードで合計8160コアの稼働が可能。

さらにSupermicroとの提携による液冷200kW構成では、4万5000コア以上を1ラックに収容できる。これにより、最新のx86システムと比較してラックあたり2倍以上の性能を発揮する。

この効率向上はコスト削減にも直結する。AIデータセンターの容量1GWあたり、最大100億ドルの設備投資削減が可能になるとしている。

エコシステムの支持と導入状況

Metaがリードパートナーとして共同開発に参画し、同社のアプリ基盤に最適化を進めている。Meta独自のAIアクセラレータ「MTIA」と連携し、複数世代にわたるロードマップで協業する。

そのほか、OpenAIやGoogle、Microsoftなど50社を超える業界リーダーが本製品への支持を表明した。クラウドからネットワーキングまで、幅広い領域での導入が見込まれる。