ニュース

Appleと日本の専門家が考える、デジタル社会におけるプライバシーのこれから

2025年8月22日 00:00

慶應義塾大学グローバルリサーチインスティテュート X Dignityセンターが主催するデジタル社会のプライバシーに関するシンポジウム「データ駆動社会におけるプライバシー保護の重要性――どのように人間の権利と尊厳を守るのか――」が開催された。

慶大大学院法務研究科の山本龍彦教授がモデレーターとなり、米Apple インターネット技術&ユーザープライバシーシニアディレクターのエリック・ノイエンシュヴァンダー氏らが登壇し、テクノロジーとプライバシーに関して議論をおこなった。

Appleで長年プライバシーに関する取り組みを続けてきたノイエンシュヴァンダー氏は、「プライバシーは基本的人権である」と強調。そうした観点から取り組むAppleの原則を説明した。

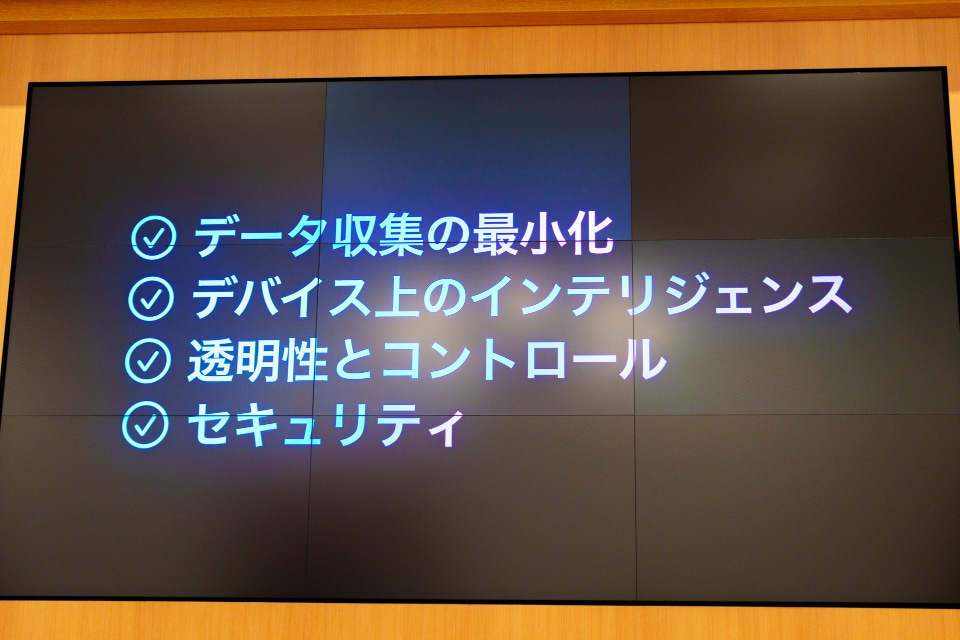

AI時代にも通用するAppleの4つの原則

まず最初にノイエンシュヴァンダー氏がAppleとプライバシーの関係について説明。同社は10年以上前から、製品・サービスの開発にあたって4つの原則を指針としているという。それが(1)データ収集の最小化(2)デバイス上のインテリジェンス(3)透明性とコントロール(4)セキュリティ――という4点だ。

(1)が「最も強力な保護の仕方」(ノイエンシュヴァンダー氏)であり、なるべく集めるデータを少なくしつつ、提供するユーザー体験はしっかりとしたものを作る、という考え方だ。データを一切収集しないという意味ではなく、体験によってはデータ収集が必要になるが、そこでも収集するデータを厳選し、識別可能なデータであれ、匿名化されたデータであれ、どのようなデータをなぜ集めるかといった点を明確化する。

(2)は、オンデバイスで処理をおこなうことで、端末のデータが外部に送信されないため、これによって「脅威のリスクが最小限になる」とノイエンシュヴァンダー氏は指摘する。これを実現するために同社ではApple Neural Engineやそのための自社開発のチップなどを用意してきた。

それでも一定のデータは収集されるし、デバイス上に個人データは保管される。必要に応じて送信される情報もあるため、(3)の透明性とコントロールが重要になる。データを何に使っているのか、そしてそのデータをユーザーがその利用状況を理解してコントロールできるようにする。

こうした原則も(4)のセキュリティがベースにあってこそで、セキュアな設計の上に成り立っているという。たとえばアプリがカメラを使用するとき、ユーザーはそれを確認してオンオフもできるが、セキュリティが破られると、そのコントロールができなくなってしまう。

加えて、暗号化も重要だとノイエンシュヴァンダー氏は言う。これによってデータは適切なキーを持つ人だけが読み取れる。たとえばiMessageは2011年の提供当初からエンドツーエンドの暗号化(E2EE)がおこなわれており、Appleサーバーを介してメッセージがやりとりされているが、Appleがメッセージ内容を把握することはできない。

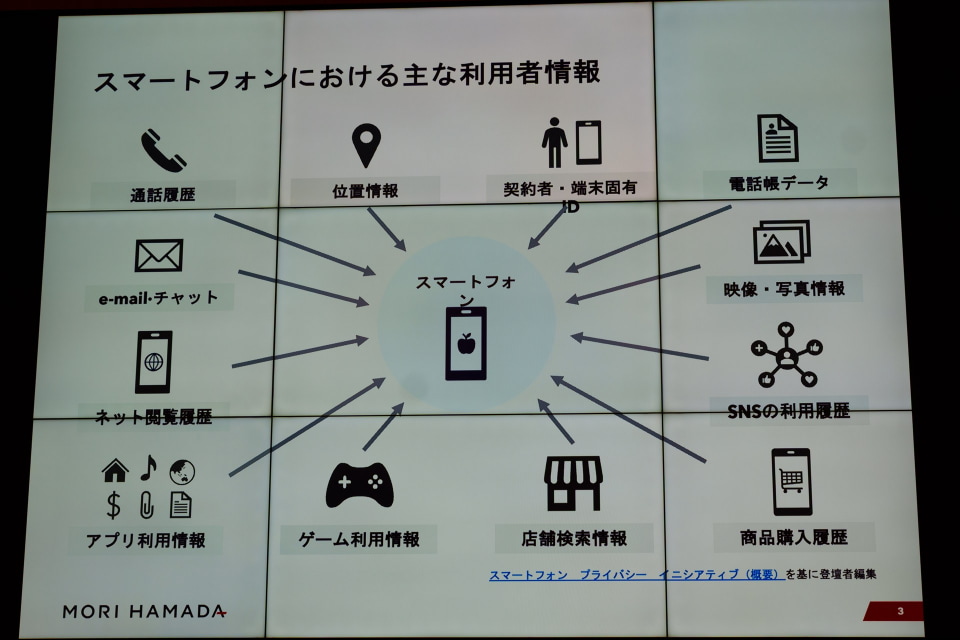

ただし、スマートフォンはサードパーティのアプリも使われる。そこでのプライバシー保護も課題になる。デバイスには機密性の高い個人のデータが保存され、常に持ち歩いているので、生活パターンや所在地にアクセスできてしまう。Appleでは、アプリによるメリットをユーザーが享受できるようにしつつも、データ保護に関しては信頼と安心を感じられるように取り組んでいるとノイエンシュヴァンダー氏は説明する。

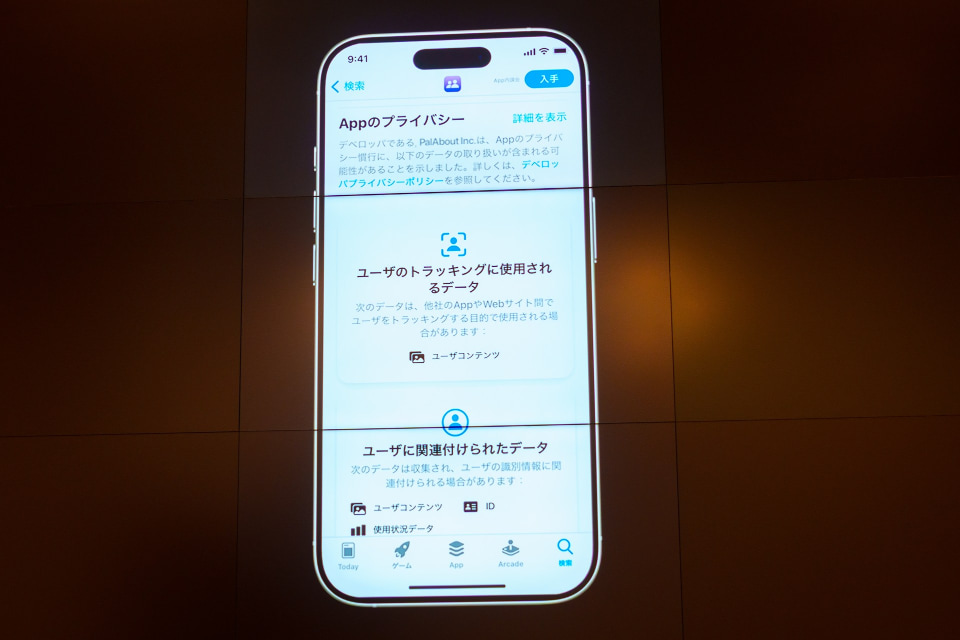

そのひとつが、App Storeにおける「栄養ラベル(Nutrition Label)」だ。これは、食品の裏面にある栄養ラベルのように、アプリがデータをどのように扱うか、収集データや関連付け、共有などをユーザーがわかりやすいようにシンプルに表示する仕組みだ。App Storeではこのラベル表示が義務付けられている。透明性を高めるとともに、開発者がデータの利用に関してより思慮深く考えることでデータを最小化することにも貢献するという。

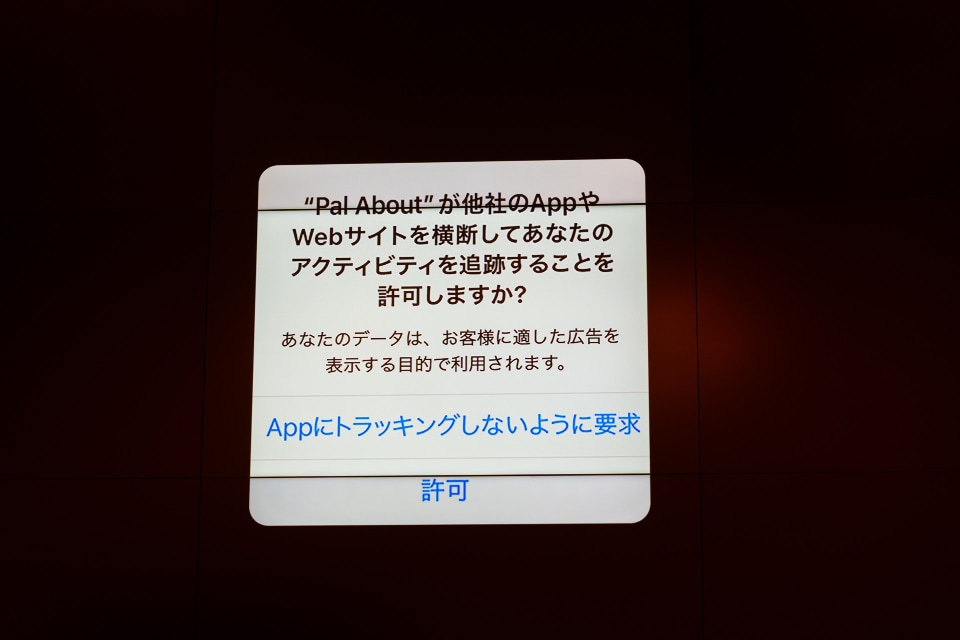

Appleではユーザーデータの収集に加え、ほかの企業との共有やプロファイル作成、広告利用、データブローカーへの販売といったデータ利用についても、事前にユーザーの許可を得ることが義務付けられている。

ここで、ユーザーが繰り返しの同意作業に疲弊してしまうことを考慮して、開発者が許可を求めるタイミングや説明方法の工夫、コンテキストに合った選択肢の提供が重要であるという。

こうした観点から、世界中でアプリストアへの規制を強化してサードパーティのストアにも開放しようという動きにノイエンシュヴァンダー氏は言及。これまで説明されたようなプライバシーについての取り組みが、統一的に提供され続けられるかという懸念を表明している。同社の仕組みは透明性の重視だけでなくユーザー体験の向上にも寄与するとノイエンシュヴァンダー氏は指摘する。

Appleは当初からプライバシーを重視していたが、iTunes StoreやApple製品の購買データやiCloud以前のMac間だけのデータ転送といった程度の個人データしか保有していなかった。重要な転機となったのは2010年のSiriの買収だったという。これによってAppleは、音声をサーバーで処理する必要が生まれるなど大量の個人データを扱うようになった。その後、2013年に4つの原則が生まれた。

こうした流れの中でAIが登場してきているが、「4つの原則が古くなったと言われるかもしれない」とノイエンシュヴァンダー氏。しかし、データ最小化やオンデバイスのインテリジェンス機能といった技術は非常に有効だとしている。

今秋登場予定のiOS 26におけるインテリジェンス機能では、APIによってサードパーティにも機能が提供される。オンデバイスだけでなく、大量のメモリやバッテリーを消費する大規模な処理に対処するために、Appleでは「プライベートクラウドコンピューティング」を開発した。これは、クラウドを活用したAIの処理をおこなう際に、データ保存の禁止と検証可能なプライバシー保証という2つの原則のもとでプライベートクラウドを活用するというやり方だ。

誰でもプライベートクラウド上で実行されるコードを検証可能で、データも保存されず、アクセス権限も付与されないため、あくまでその時の処理のためだけに使われるプライベートなクラウドになっているという。

AI時代においてもAppleは4つの原則を保ち、プライバシーを基本的人権として保証する。それによってユーザーがAIも安心して利用でき、個人のデータが尊重されることを、ノイエンシュヴァンダー氏は強調していた。

日本のプライバシーにおける法制度の弱点

日本では、プライバシーに関連する法制度としては個人情報保護法はあるが、パネリストの一人で弁護士の呂佳叡氏は、欧州のGDPRなどと比べても「ガラパゴス規制になっている」と指摘する。個人情報の定義が狭い点が問題だと呂氏は説明。

モデレーターの山本教授は、個人情報保護法が「個人の人格的、財産的な権利利益全体を包含しつつ、プライバシーが主要なものとされている」との論を展開し、日本ではプライバシーと個人データ保護が密接に関連していると指摘する。

そうした上で山本教授は、プライバシーの考え方として「個人がコントロールする」「共有相手を選択できるというコントロール」と「共有相手のセキュリティがしっかりしていること」という2点の要素を提示。その観点からAppleの透明性とコントロールの原則を重要だと指摘する。

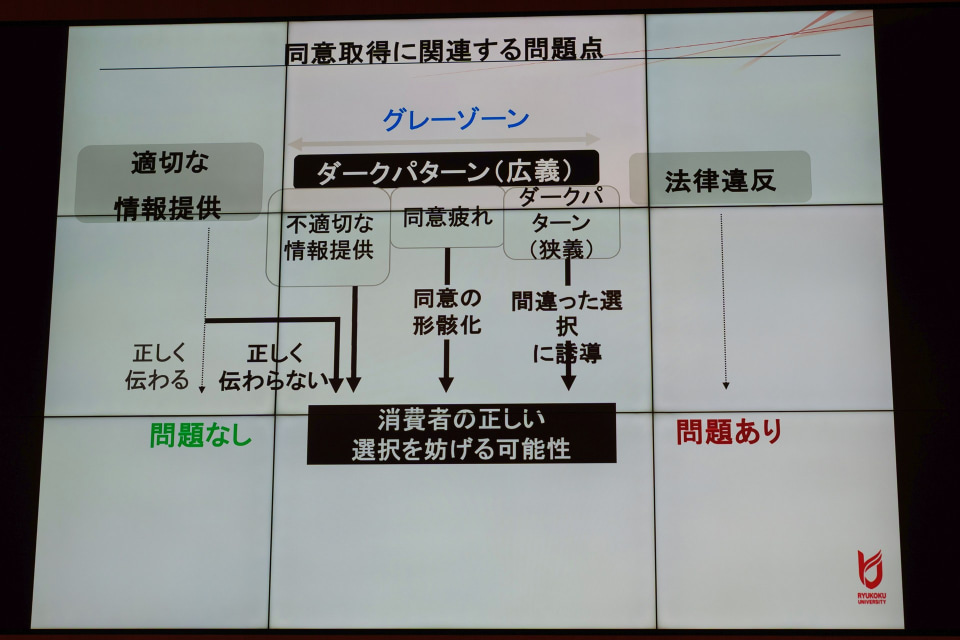

ただ、コントロールの一環であるユーザー同意について、その有効性が失われているという議論もあるという。同意を求められすぎることによる同意疲れや、同意の形骸化といった観点もあり、さらに山本教授は個人の決定や同意を重要視しすぎると、かえって個人の責任が重くなりすぎるといった懸念も指摘する。

それに対して龍谷大学のカライスコス・アントニオス教授は、消費者保護の観点から「同意は必ず必要であり、同意をどのように機能させるかが重要」だと強調した。日本の法制度における、「同意取得で適切な情報提供がされていれば問題ない」という考え方に対して、グレーゾーンが幅広く、ダークパターンによる同意の形骸化や同意疲れといった問題が発生しうると警鐘を鳴らす。

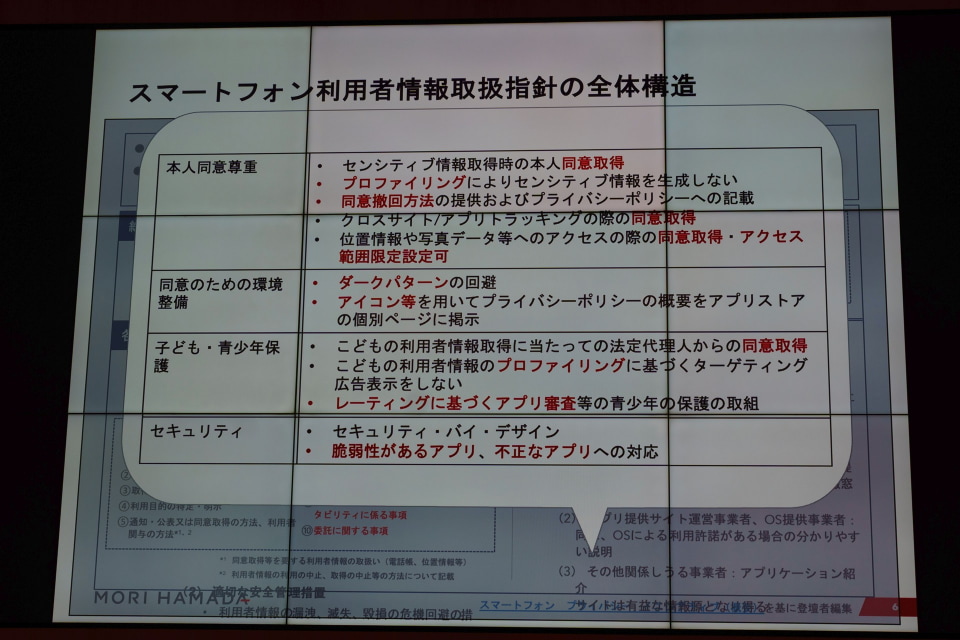

さらにアントニオス教授は、日本の法制度では子供に対するデータ保護が遅れている点も問題視。海外で子供の情報取得が難しくなり、日本が狙い撃ちされる危険性を指摘した。

名古屋大学大学院の林秀弥教授は、事業者などの信頼が大事なことに加えて、日本では信頼を裏切ったときの制裁(サンクション)が弱いという点を問題視する。個人情報保護法で課徴金を導入する議論があったものの、「経済界が反対して潰された」として、経済的制裁、刑事、民事、行政などの多角的な制裁が必要だと言及した。

Appleのようなデジタルプラットフォーム事業者は「ある程度信頼せざるをえない状況」と位置づける。ユーザーとデジタルプラットフォーム事業者との間の情報が非対称で、すでにプラットフォームに依存している現状など、ユーザーがデジタルプラットフォーム事業者を信頼することをバックアップするような制度が必要との認識を示す。

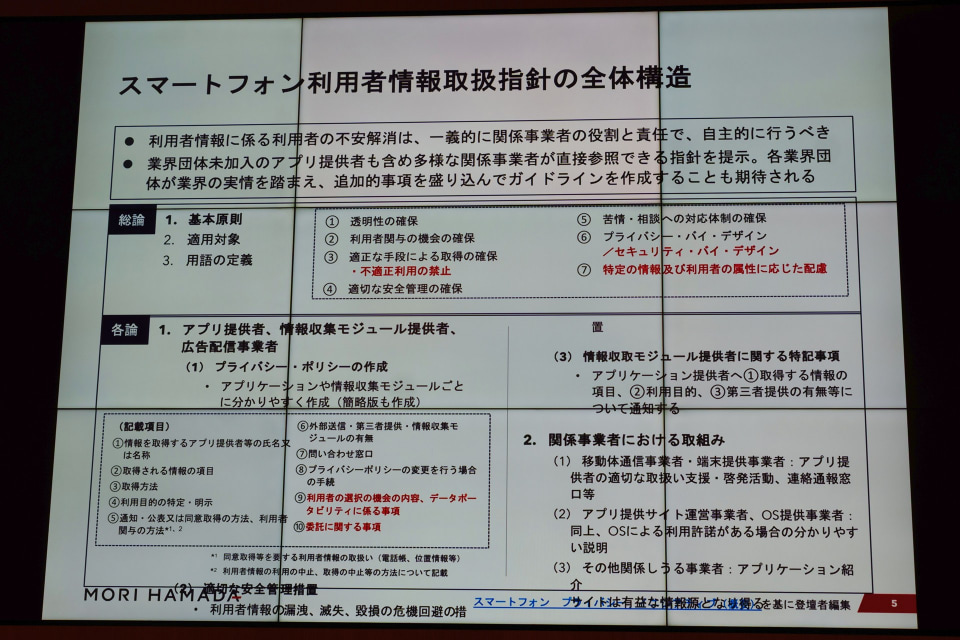

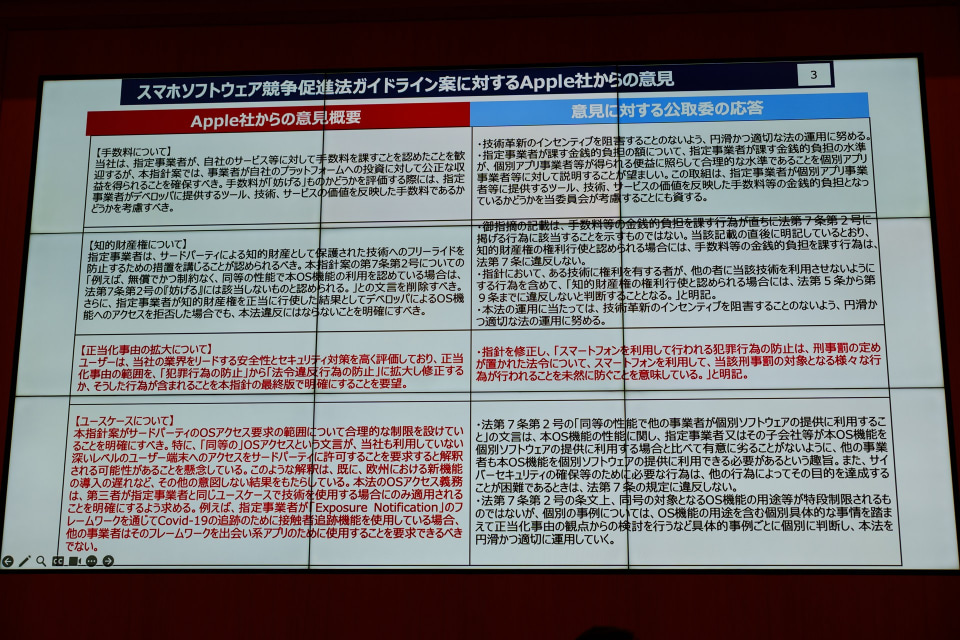

呂弁護士はスマートフォンプライバシーセキュリティイニシアティブ(SPSI)、林教授はスマートフォン・ソフトウェア競争促進法についてそれぞれ言及。SPSIではAppleの取り組みも参考に改定がおこなわれており、10年ぶりの改定で時代にあったガイドラインになっているとの認識。競争促進法については、Appleの意見に対する公正取引委員会の回答が「かみ合っていない」と林教授は指摘している。

同意を理解するためのリテラシー向上が必要か

ネット上では、「iPhoneで音声通話しただけでそれに関連する広告が出るようになった」という声もあり、ノイエンシュヴァンダー氏が「iOSから通話内容は見られない」としつつ、エコシステム全体のインフラまで考慮する必要があるとの意見を示す。

技術的に考えれば、音声通話が広告の原因というのは基本的には誤解に基づくものではあるだろう(おそらく別のタイミングでの検索や位置情報を使ったアプリなどが理由かもしれないが定かではない)。とはいえ、こうした複雑化したエコシステム、形骸化した同意など問題は根深いようにも思える。

筆者の質問に対して、同意で何を求められているのか、それに同意してもいいのかという判断ができるようなユーザー側のリテラシー向上も求められることは、パネリスト全員の意見が一致したところだが、たとえば呂弁護士は、「事業者側のリテラシー向上も必要」と指摘。サイトやアプリからどういった情報が外部に送信されているか事業者が把握していないという実態があったことを明かして、事業者自身が正確に把握する必要性を訴える。

アントニオス教授は、「わかりやすい説明が必要」と指摘。事業者は商品のプロモーションはわかりやすく説明するのに対して、プライバシーポリシーや約款はテキストのベタ打ちでわかりにくく、「PRと同じようなわかりやすい情報提供が必要」と主張した。

アントニオス教授は、たとえばAIエージェントにあらかじめ設定しておけば、プライバシーポリシーなどを踏まえてユーザーの希望に応じた対応をしてくれるといったように、技術的な可能性についても言及する。

林教授は、リテラシーの二極化の問題点を指摘。利用者の属性などにきめ細かく配慮した情報提供が必要であるとして、特にデジタルで完結するような場合に取り残される消費者に対する行政や事業者団体の取り組みを重要視した。