ニュース

iPhoneアプリでオンデバイスAIアプリが開発できるように、Appleが事例を紹介

2025年10月1日 06:00

アップル(Apple)は、9月にリリースされたiOS 26やiPadOS 26、macOS 26で同社の生成AIサービス群「Apple Intelligence」でも利用している大規模言語モデル(LLM)をサードパーティアプリでも利用できるようになったとし、早速活用されているアプリを紹介している。

Foundation Modelsフレームワークを活用すると、既存の開発環境はそのままに、オフラインでのAI推論を無料で利用できる。Foundation Modelsフレームワークは、Swiftと緊密に統合されており、既存のコードから30億パラメータのデバイス内モデルへ簡単にリクエストを送れる。

同社では、学生の試験対策用にパーソナライズされた問題作成や、ワークアウト指標を元にしたサマリーの提供など、開発者は新しく魅力的なアプリが作成できるとしている。

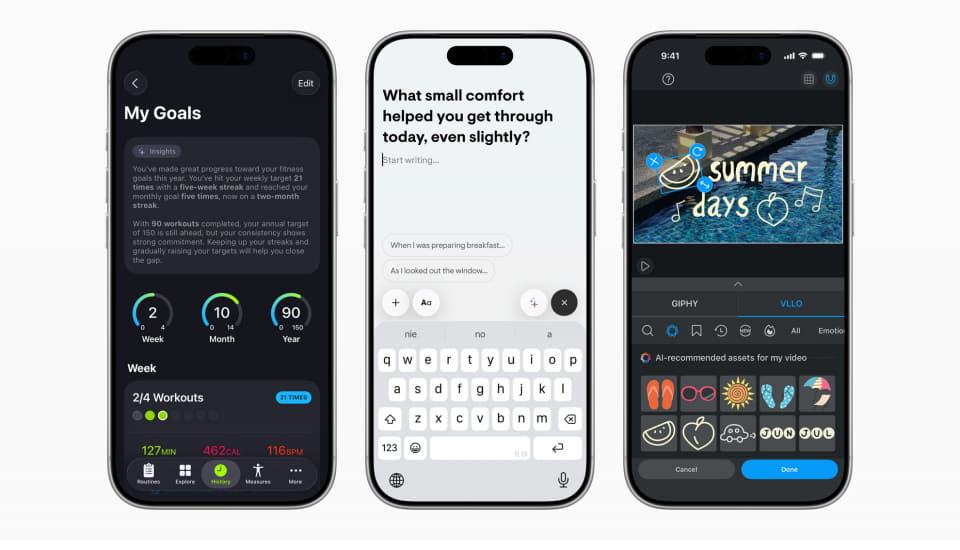

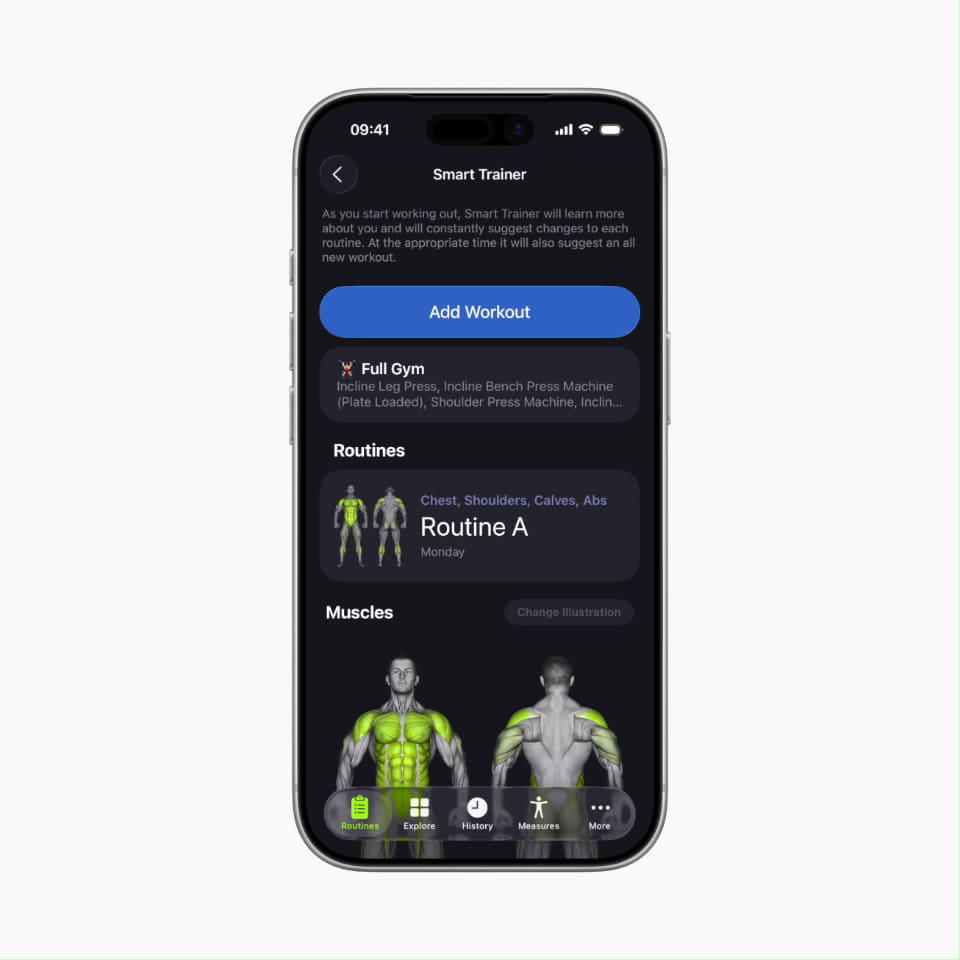

たとえば、「SmartGym」アプリでは、ユーザーのワークアウトを継続的に学習し、トレーニング内容を調整するアドバイスを送る。月ごとの進捗など、ワークアウトのさまざまなデータをゆーざーにわかりやすく表示し、ユーザーお気に入りのスタイルに調整されたコーチングメッセージを受け取れる。

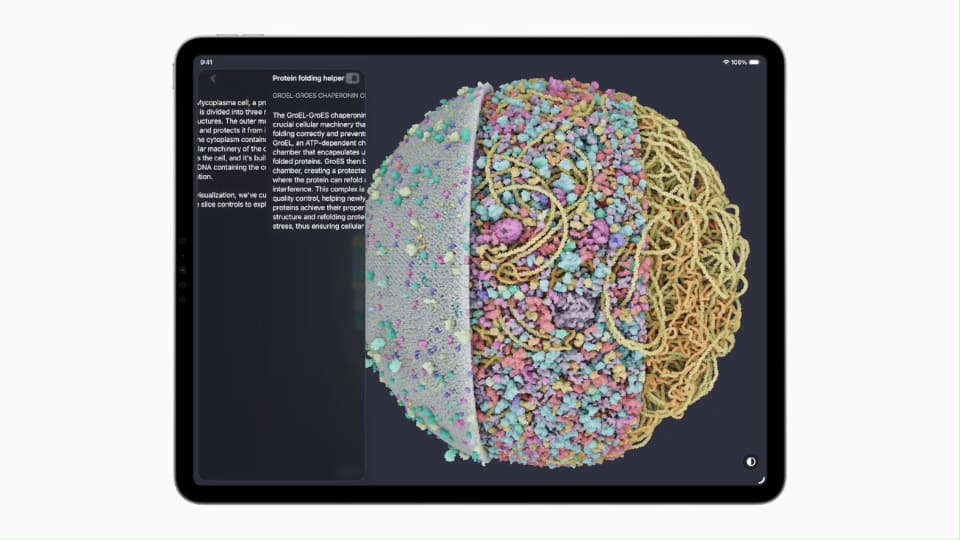

また、生物学アプリ「CellWalk」では、ユーザーにあわせて用語に関する会話形式の説明を生成したり、ユーザーの学習履歴にあわせた説明のカスタマイズをしたりしている。これにより、「テキスト自体が生き生きと動き、学習者それぞれに適応する動的なシステムとなった」(CellWalk開発者のデイヴィソン氏)としている。

このほかにも、健康管理やToDo管理、Vlog作成アプリなどですでに利用されている。ユーザーが自然言語でエクササイズの相談ができたり、自然言語のタスクを整理し分類したりできるようになり、アプリの操作性やパーソナライズ性能が飛躍的に向上する。