みんなのケータイ

スマホに載せたローカルAI「Gemma4」に未来を感じる

【Pixel 8a】

2026年4月15日 00:10

スマホやパソコンで「AIが使える」と言っても、多くの場合、“窓口”に過ぎません。実際の処理は、インターネットの向こう側、データセンターの巨大なコンピュータで動いています。AIはそれだけ大量のメモリーと計算能力を必要とするからです。

ところが最近、その常識が少し変わりつつあります。ゲーミングPCにローカルAIを載せる動きは以前からありましたが、ついに「スマホでローカルAIを動かす」という流れが見え始めてきました。

きっかけのひとつが、Googleが公開した「Gemma4」です。AIの中核部分にあたるモデルが、商用利用も可能なApache-2.0ライセンスで提供されており、しかもスマートフォンでも動かせる軽量モデルが用意されています。

そして導入も意外なほど簡単です。スマホの場合は、グーグルの「Google AI Edge Gallery」というアプリをインストールし、その上でGemma4を動かすだけ。これなら誰でも試せます。

ということで筆者も、最小構成モデル「Gemma4-E2B-it」を手元のPixel 8aに入れてみました。

Google Playストアから「Google AI Edge Gallery」をインストールし、起動してGemma4をロードするだけです。AIモデルのダウンロードは約2.5GBあるのでWi-Fiの利用がオススメ。これで準備完了。

ちなみに、iPhone 15でもApp Store版のAI Edge Galleryで動作しました。

AI Edge Galleryでは、「AI Chat」「Ask Image」など複数の機能が使えますが、まずは「AI Chat」を試してみます。すると、ネット接続なしでも、かなり軽快に応答してくれます。

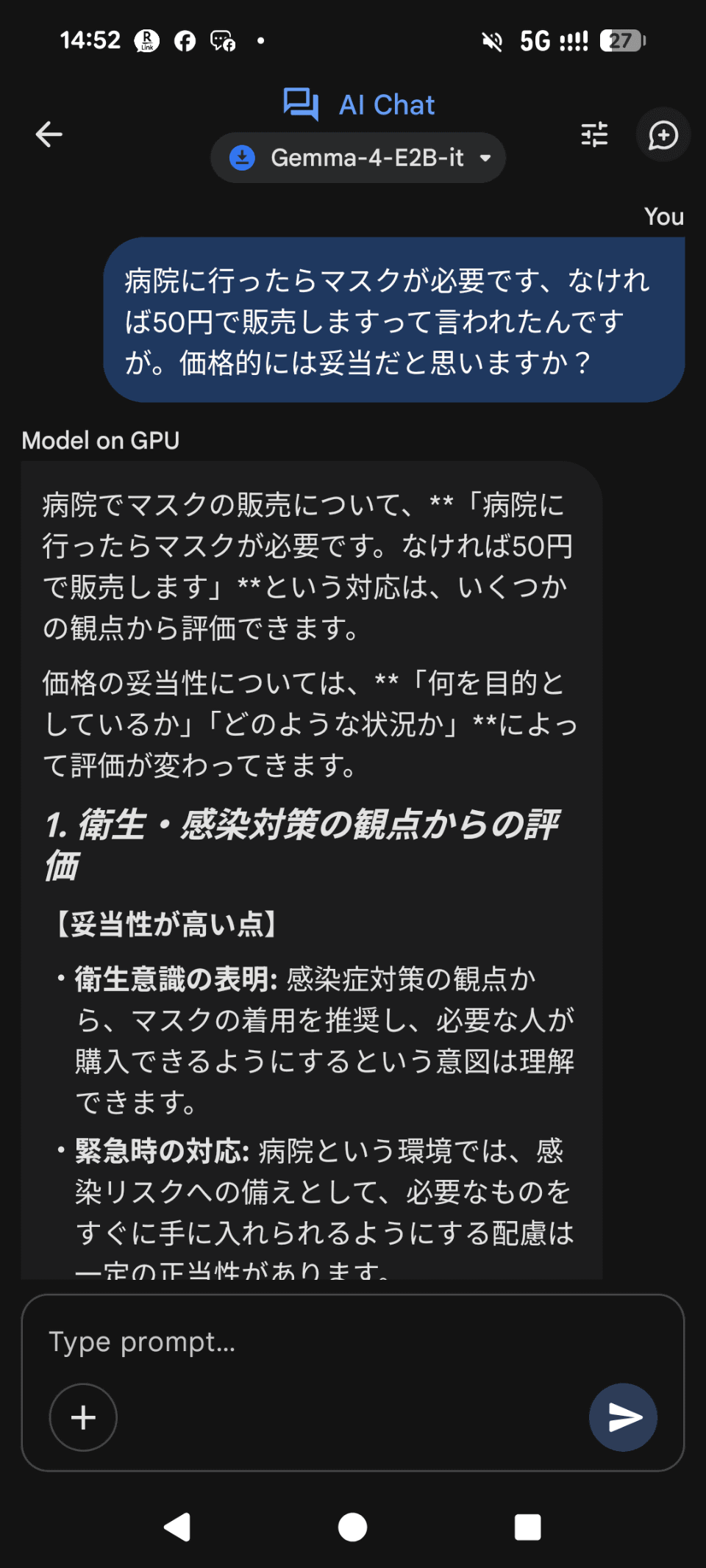

試しに、病院でマスクを忘れた愚痴をこぼしてみたところ、「それは採算度外視で配布しているのだからありがたく買うべきです」と、妙に現実的な返答が返ってきました。うむ、AIさん、しっかりしている。

もちろん弱点もあります。インターネットには接続していないため知識は一定の時期からアップデートされません。今回の環境では2025年初頭までです。また、日本語が少し不自然になることがある、チャット履歴が保持されない、といった制約があります。

それでも驚くのは、その動作の軽さと応答の質です。体感的には、クラウドAIと比べても極端に見劣りする感じはありません。むしろ、「このサイズでここまでやるのか」と感じる場面の方が多いくらいです。

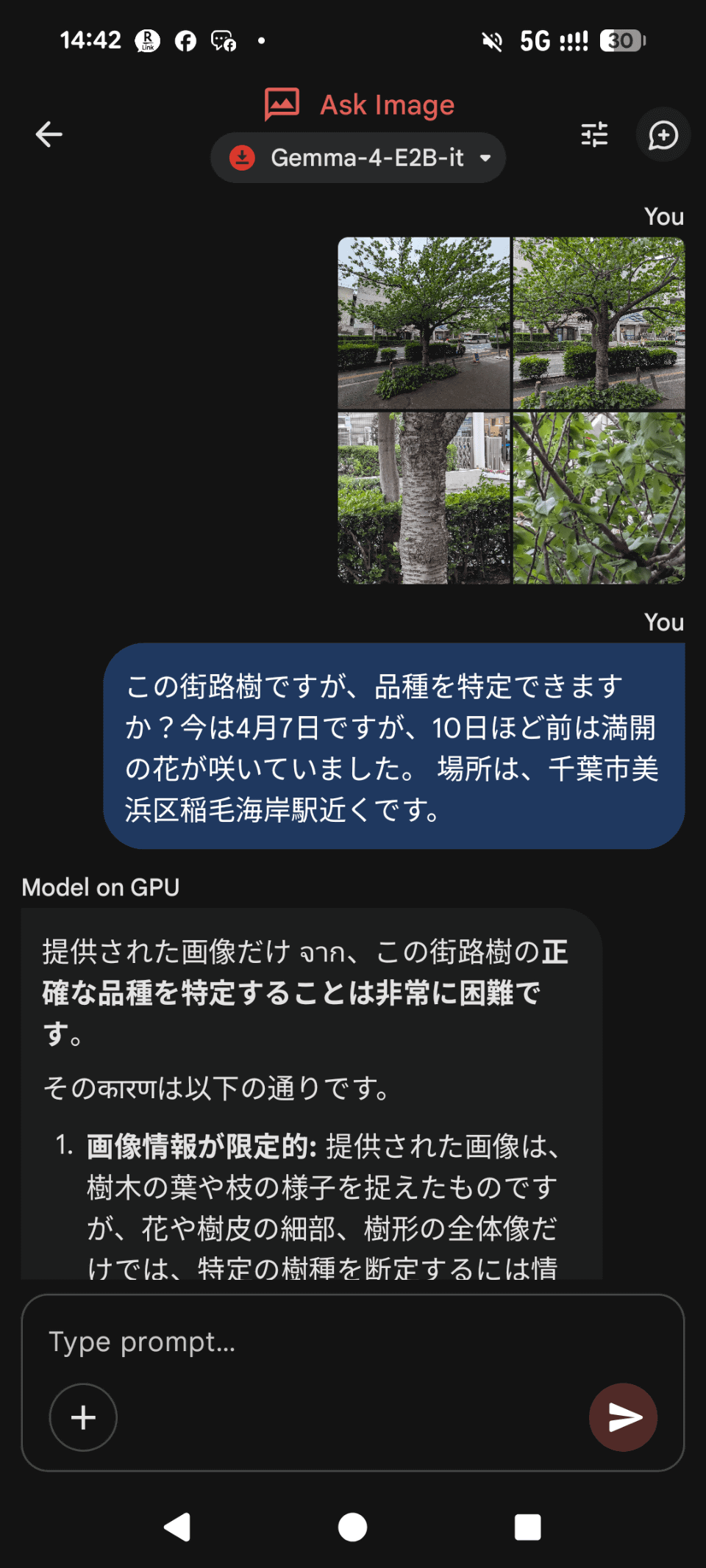

Gemma4はマルチモーダルにも対応しています。「Ask Image」で街路樹の写真を見せて品種を尋ねてみたところ、一発正解とはいきませんでしたが、候補を挙げつつ追加情報を求めてくるなど、AIらしい挙動をきちんと見せてくれました。

さすがにクラウドの最新AIと比べれば絶対性能では劣ります。しかし、スマートフォン単体、しかもオフラインでここまで動くという事実はインパクトがあります。

小さなデバイスの中で、通信せずに即座に応答するAI。これは単なる「便利」ではなく、「使い方そのものが変わる」。もはや可能性しか感じません。

まだ触っていない人は、一度試してみてほしいところです。ハマる人には、かなり強烈に刺さるはずです。