ニュース

AI音声クローンで「家族の声」で詐欺、米国FTCが注意喚起

2026年1月16日 15:19

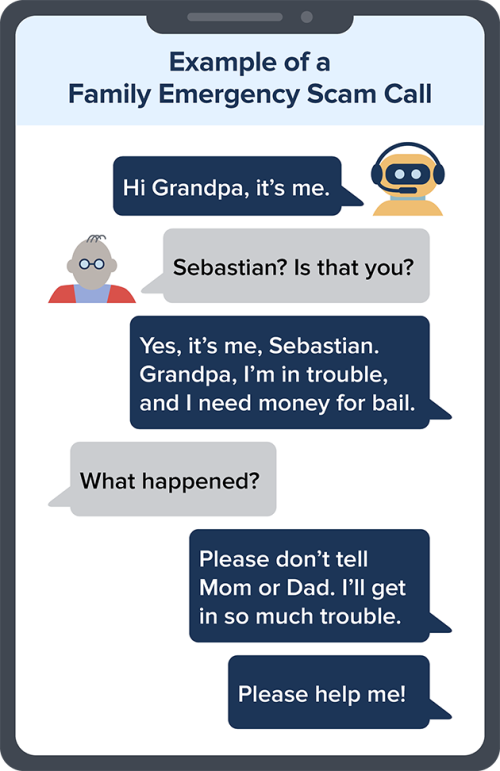

米国連邦取引委員会(FTC)は、AIによる音声クローン技術を悪用して家族の声を装って金銭を要求する詐欺が増えていると注意喚起している。

こうした詐欺行為に必要となるのは、オンラインに投稿されたコンテンツから入手できる「家族の短い音声クリップ」と、「音声クローン作成プログラム」のみで、家族や知り合いの音声に容易になりすましできるという。

対策方法や見分け方

FTCでは、クローン技術によって複製される声だけを信用するのではなく、連絡してきたとされる本人に折り返しの電話をかけて事実を確認することを呼びかけている。本人に連絡がつかない場合は、他の家族や友人・知人を介して連絡を取り、本人による連絡であるのかを確認すべきとしている。

また、詐欺師は返金や取り戻すことが困難な方法で支払い・送金を求めてくる傾向があり、たとえば暗号資産や仮想通貨、ギフトカードの番号とPIN(暗証番号)を教えるように言ってきた場合、詐欺の可能性が高いという。

FTCがこうした注意喚起を促す理由として、米国では既に祖父母をターゲットとするAIによるクローン音声の「オレオレ詐欺」が多発しており、残念ながら実際に被害にあった報告も複数ある。

声で見分けることが困難な場合には、事前に合言葉を決めるなど、本人確認を行うように呼びかけしている。